この記事のポイント(30秒で読める)

- 米国防総省がAI企業Anthropicを「サプライチェーンリスク」に正式指定。米国企業として史上初の異例事態

- 原因は「自律型兵器と大規模監視にはAIを使わせない」というAnthropicの倫理方針。一方OpenAIは2億ドルで軍と契約

- 禁止されたAnthropicのClaudeはApp Store1位に急浮上、無料ユーザー60%増、有料会員は倍増。「倫理」がブランド力になった

何が起きたか──AI史上最大の「国 vs 企業」対立

2026年3月5日、米国防総省はAI企業Anthropic(アンソロピック)に対し、「サプライチェーンリスク」に正式指定する書簡を送付しました。即時発効です(TechCrunch)。

これは通常、中国やロシアなどの敵対国の企業に使われる措置です。アメリカのテック企業がこの指定を受けたのは史上初。異例中の異例です(NPR)。

何が対立の原因だったのか。国防総省はAnthropicのAIモデル「Claude」を、あらゆる合法的な軍事目的に制限なく使いたいと要求しました。Anthropicはこう返しました。

「2つだけ、例外にしてほしい。完全自律型兵器と米国民の大規模な国内監視には使わせない」(Anthropic公式ブログ)

国防総省はこの条件を拒否。交渉は決裂しました。

OpenAIは即座に契約──対照的な2社の選択

Anthropicの排除が発表されたのとほぼ同時期に、OpenAIは国防総省と最大2億ドル(約300億円)の契約を発表しました(TechCrunch)。

OpenAIも「レッドライン」を設けています。大規模国内監視、自律型兵器システム、ソーシャルクレジットのような自動判定システムには使わないと。ただし、批判が殺到しました。MIT Technology Reviewは「OpenAIの”妥協”は、まさにAnthropicが恐れていたものだ」と報じています(MIT Technology Review)。

OpenAIのサム・アルトマンCEO自身も「日和見的で雑に見えた」と認め、契約内容を修正しました(CNBC)。

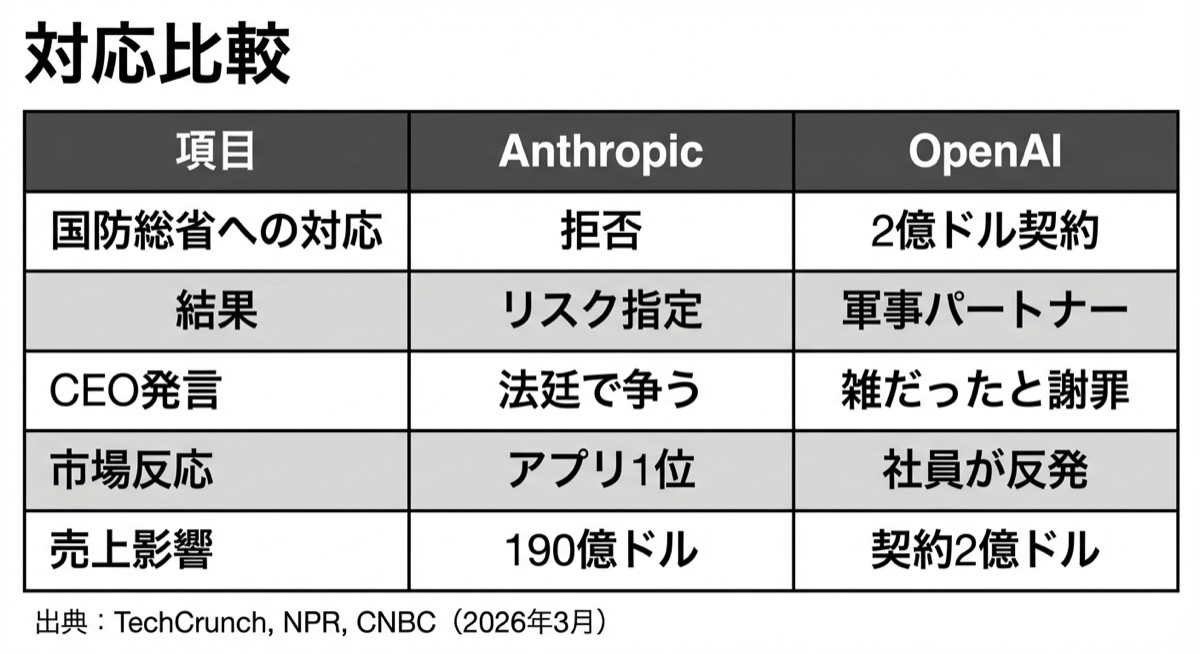

2社の対応は対照的です。

| Anthropic | OpenAI | |

|---|---|---|

| 国防総省への対応 | 自律型兵器・大規模監視には使わせないと拒否 | 最大2億ドルで契約(後に条件修正) |

| 結果 | サプライチェーンリスクに指定 | 軍事AIの主要パートナーに |

| CEOの発言 | 「法的に不当。法廷で争う」 | 「日和見的で雑だった」と謝罪 |

| 市場の評価 | Claude App Store 1位、ユーザー急増 | 一部社員が内部で反発 |

禁止されたのに売れる──「ストライサンド効果」が直撃

ここからが面白い話です。

国防総省に「危険」とレッテルを貼られたAnthropicのClaude。普通なら業績に打撃を受けるはずです。実際に起きたのは真逆でした。

- App Store 1位に急浮上。ChatGPTを抜いた(CNBC)

- 無料ユーザーが1月比で60%以上増加

- 有料サブスクリプション会員が年初から倍増

- 1日あたりの新規登録数が毎日過去最高を更新

- Googleでの「Anthropic」検索数が創業以来最高を記録

「ストライサンド効果」です。隠そうとすればするほど、注目が集まる。SNS上では「軍に使わせないAIを選ぶ」という声が広がり、ChatGPTからClaudeへの乗り換えが相次ぎました。

ビジネスへの影響も限定的でした。Anthropicの売上の80%はエンタープライズ(企業向け)。年間売上ランレートは190億ドル(約2.9兆円)超。Microsoftは「国防総省との契約に直接関わる利用以外は、引き続きAnthropic製品を提供する」と明言しています(CNBC)。

SaaS市場43兆円消失──Claude Coworkの破壊力

話はこれだけではありません。Anthropicは2月5日に「Claude Cowork」という新しい企業向けプラットフォームをリリースしていました。

Claude Coworkは、AIを「チャットの相手」から「自律的に仕事をするデジタル同僚」に変えるもの。Google Drive、Gmail、DocuSign、Salesforce Slack、FactSetなどと直接連携し、AIが書類作成からデータ分析まで一気通貫でこなします(TechCrunch)。

市場の反応は激烈でした。ソフトウェア、金融、資産運用セクターから約2,850億ドル(約43兆円)の時価総額が消失。「SaaSpocalypse(SaaS黙示録)」と呼ばれる事態です(Financial Content)。

Thomson Reutersは1日で15.83%下落。ServiceNowは52週高値から48.5%下落しました。既存のSaaS企業が、AIエージェントに「置き換えられる」恐怖が市場を席巻したのです。

なぜ重要か──日本企業が学ぶべき3つの教訓

教訓1: AIの「倫理方針」が最大のブランド資産になる

Anthropicの事例が示すのは、「正しいことをしたら儲かった」という単純な話ではありません。AI企業の倫理方針が、製品の品質と同等の購買決定要因になったということです。

日本企業がAIツールを導入するとき、「速い」「安い」だけで選ぶ時代は終わりつつあります。そのAI企業がどんな倫理方針を持っているか。データをどう扱うか。これが取引先や消費者からの信頼に直結する時代が来ています。

教訓2: 「SaaSpocalypse」は対岸の火事ではない

Claude Coworkによる43兆円の時価総額消失。日本のSaaS企業は今回比較的軽傷でした(人手不足を補うAIという文脈があるため)。しかし安心はできません。

AIエージェントが「業務ソフトを使いこなす側」になると、個別のSaaSツールの価値は相対的に下がります。日本のSaaS企業は、「AIに使われるツール」から「AIでは代替できない価値を持つツール」への転換を急ぐ必要があります。

教訓3: AI依存の地政学リスクを織り込む

AnthropicのCEOダリオ・アモデイは法廷闘争を宣言しています。しかし判決が出るまで、国防総省の関連企業はClaudeを使えません。

これは日本企業にも重要な示唆を与えます。米国のAI企業に業務を依存している場合、地政学リスクがAIの可用性に直結するということ。特定のAIベンダーに全依存するのではなく、複数のAIモデルを使い分ける「マルチAI戦略」がリスク管理として不可欠です。

どう活かすか──明日からできる3つのアクション

1. 自社のAI利用ポリシーを策定する

まだ「AIポリシー」を持っていない企業は、今すぐ作るべきです。どのAIツールを使い、データをどう扱い、どんな用途には使わないか。Anthropicの事例が示すように、AIに関するスタンスは企業の信頼性に直結します。小さな会社でも、「私たちはAIをこう使います」と明文化しておくことが差別化になります。

2. AIベンダーを1社に絞らない

Claude、ChatGPT、Gemini──主要AIは3つあります。業務の種類によって使い分ける「マルチAI体制」を検討してください。今回の事件で、1社依存のリスクが明確になりました。コストは多少上がっても、事業継続性の保険として十分に価値があります。

3. 「AIで代替できない自社の強み」を言語化する

SaaSpocalypseが突きつけた問いは、「あなたの仕事、AIがやったら何が残る?」です。これは個人にも企業にも当てはまります。残るのは、人間の判断力、信頼関係、文脈の理解、そして倫理観。今のうちに「AIにはできない自社の価値」を定義し、そこにリソースを集中させるべきです。

まとめ──「倫理」は綺麗事ではなく、経営戦略になった

Anthropicが国防総省に拒否されてApp Store 1位になった事実。これは2026年のビジネスにおける最も重要なシグナルの一つです。

AI時代において、「何をするか」と同じくらい「何をしないか」が企業の価値を決める。Anthropicはそれを売上で証明しました。

日本の経営者にとっても、AI活用の「量」を競う時代から、AIとの「付き合い方」を問われる時代への転換点です。今週のAnthropicの一件は、その最初の大きな分岐点として記憶されるでしょう。

元ソース: TechCrunch / NPR / Anthropic公式ブログ / CNBC / MIT Technology Review