この記事のポイント(30秒で読める)

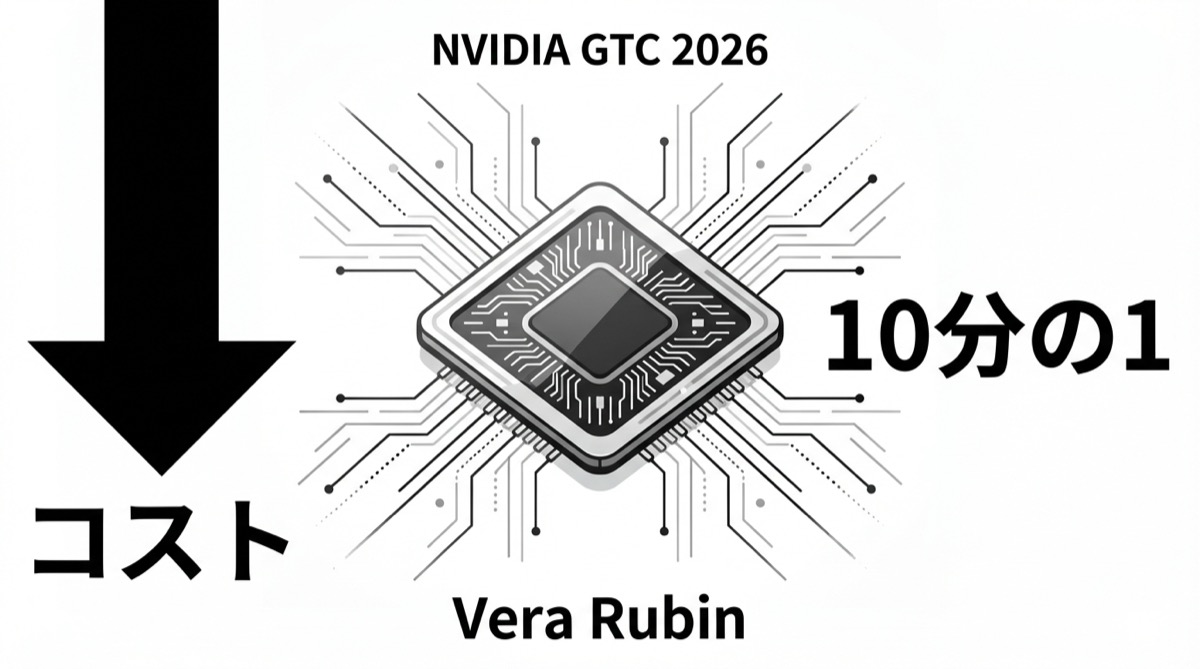

- 来週3月16日、NVIDIAが年次カンファレンス「GTC 2026」で次世代AIチップ「Vera Rubin」を正式発表。AIの推論コスト(実際にAIを動かすコスト)が現行の最大10分の1に下がる

- 同日3月9日、欧州AIインフラ企業Nscaleが20億ドル(約3,000億円)を調達。NVIDIA・Dell・Nokiaが出資し、元Meta COOシェリル・サンドバーグが取締役に。AIインフラへの投資が爆発的に増えている

- 日本企業の「AIは高すぎる」問題に、ようやく終わりが見え始めた。推論コスト最大10分の1は、AIを「大企業の特権」から「中小企業の日常ツール」に変える転換点になる

何が起きたか──「推論の時代」の幕が開く

来週月曜日、3月16日。カリフォルニア州サンノゼで、世界最大のAIカンファレンス「GTC 2026」が幕を開けます。190カ国から3万人以上が集まる、AI業界の「ダボス会議」です(NVIDIA Newsroom)。

NVIDIA CEOジェンスン・フアンは、基調講演で「世界がまだ見たことのないチップ」を発表すると予告しています。

その正体は、次世代AIプラットフォーム「Vera Rubin(ヴェラ・ルービン)」。すでにCES 2026で概要は発表されていましたが、GTC 2026が正式な「お披露目」となります。

なぜこれが重要か。一言で言えば、「AIを動かすコストが最大10分の1になる」からです。

「訓練」から「推論」へ──AI業界の地殻変動

まず、AIには2つのコストがあります。

訓練コスト: AIモデルを「育てる」ためのコスト。ChatGPTやClaudeを作るのに数百億円かかる、あの話です。

推論コスト: AIモデルを「使う」ためのコスト。あなたがChatGPTに質問するたびに発生する計算コストです。

2024〜2025年、AI業界は「訓練」に全力投資しました。より賢いモデルを作るために、より大きなGPUクラスタを構築する競争です。

しかし2026年、状況が一変しています。主戦場は「訓練」から「推論」に移った。なぜなら、AIが実際にビジネスで使われるとき、コストの大半は「推論」だからです。

毎日何百万人がChatGPTを使い、企業がAIエージェントを業務に組み込み始めた今、推論コストこそがAI普及の最大のボトルネックです。

Vera Rubinの衝撃──数字で見る「10倍革命」

NVIDIAが来週発表するVera Rubinプラットフォームの主なスペックです(NVIDIA Technical Blog)。

推論コスト: 現行Blackwellの最大10分の1

エージェンティックAI(自律的に判断するAI)や高度な推論タスクのトークン(AIが文章を処理する最小単位)コストが、現行のBlackwellプラットフォームと比べて最大10分の1に。これは「同じ質問をAIにするのに、今まで100円かかっていたものが10円で済む」という意味です。

推論性能: 3.3倍

フルラック構成(NVL144)で3.6エクサフロップスのAI推論性能を実現。現行のGB300システムの3.3倍です。

訓練効率: GPUが4分の1で済む

同じ規模のMoE(Mixture of Experts=複数の専門AIを組み合わせて効率よく動作する仕組み)モデルを訓練するのに必要なGPU数が、Blackwellの4分の1に。つまり訓練コストも劇的に下がります。

メモリ: HBM4で帯域幅3倍

1GPUあたり288GBのHBM4メモリを搭載。帯域幅は約22TB/sで、現行の約3倍。Samsung とSK Hynixが供給パートナーです(TechBriefly)。

これらの数字が意味するのは、「AIを動かす」コストが構造的に下がるということ。これまでAI導入を「コストが高すぎる」と見送ってきた企業にとって、ゲームチェンジャーです。

推論特化チップ「Rubin CPX」──長文処理のための新兵器

Vera Rubinと同時に注目すべきは、推論特化の新チップ「Rubin CPX」です(NVIDIA Technical Blog)。

100万トークン以上の長文コンテキスト処理に特化し、ビデオのデコード・エンコードと推論処理を1チップに統合。NVL144 CPXプラットフォームでは、8エクサフロップスのAI性能と100TBの高速メモリを1つのラックに搭載します。

これは実務で何を意味するか。企業の膨大な社内文書、契約書、マニュアルを丸ごとAIに読み込ませて質問できるということです。

さらに先の未来──2028年「Feynman」の衝撃

GTC 2026では、2028年リリース予定の次世代アーキテクチャ「Feynman(ファインマン)」のプレビューも噂されています(TradingKey)。

Feynmanの注目点は2つ。

1. TSMCの1.6nmプロセス: 現行の3nmから大幅に微細化。消費電力あたりの性能がさらに向上します。

2. シリコンフォトニクス: チップ間の通信を従来の銅線から「光」に置き換える技術。データ転送速度が飛躍的に上がり、消費電力は下がります。

2028年までに、AIの推論コストは今の数十分の一になる可能性がある。AIが「電気」や「インターネット」のようなインフラになる未来が、急速に近づいています。

AIインフラ投資が爆発している──Nscale 3,000億円調達の意味

NVIDIAのチップだけではありません。AIインフラ全体への投資が歴史的な規模で爆発しています。

3月9日: Nscaleが20億ドル調達(欧州史上最大)

昨日(3月9日)、英国のAIインフラ企業Nscaleが20億ドル(約3,000億円)のシリーズC資金調達を発表しました。欧州のスタートアップとして史上最大です(TechCrunch)。

出資者にはNVIDIA、Dell、Nokia、Citadel、Point72が名を連ね、元Meta COOシェリル・サンドバーグと元Meta国際政策担当ニック・クレッグが取締役に就任。評価額は146億ドル(約2.2兆円)です(Nscale)。

Nscaleはノルウェーに「Stargate Norway」と呼ばれるAIデータセンターを建設中。2026年末までに10万台のNVIDIA GPUを稼働させ、OpenAIを顧客に持ちます。

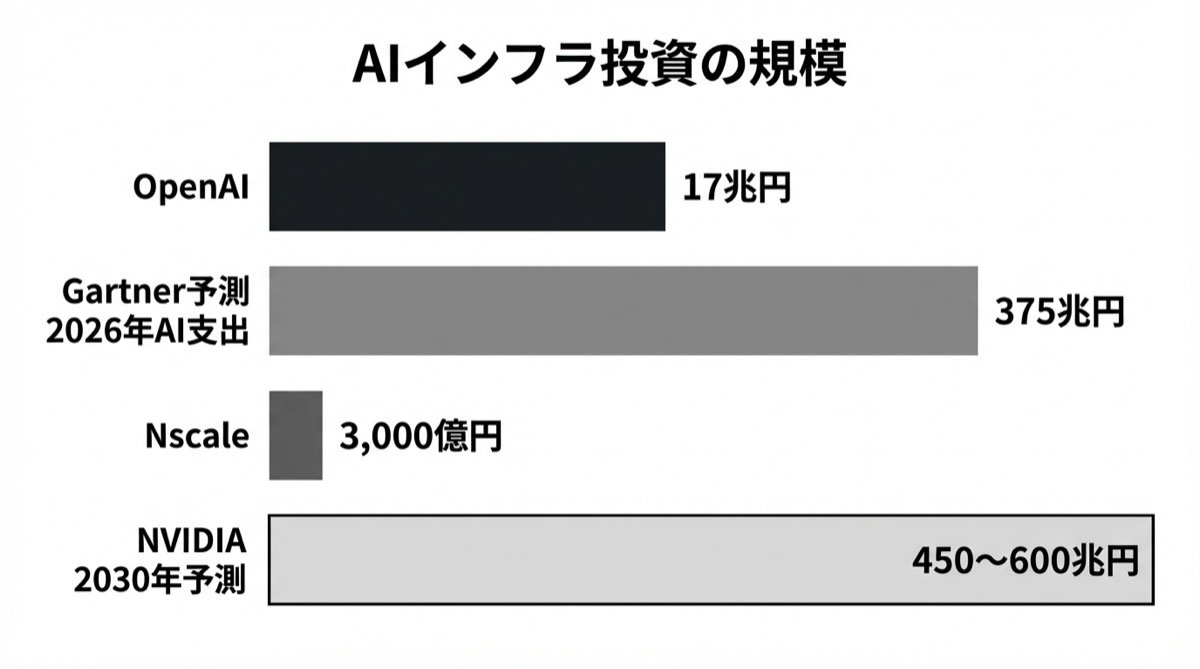

数字で見るAIインフラ投資の規模

AIインフラへの投資額を整理すると、その規模の異常さがわかります。

- OpenAI: 1,100億ドル(約17兆円)調達。Amazon 500億ドル、NVIDIA 300億ドル、SoftBank 300億ドル(TechCrunch)

- Nscale: 20億ドル(約3,000億円)。欧州史上最大のスタートアップ資金調達

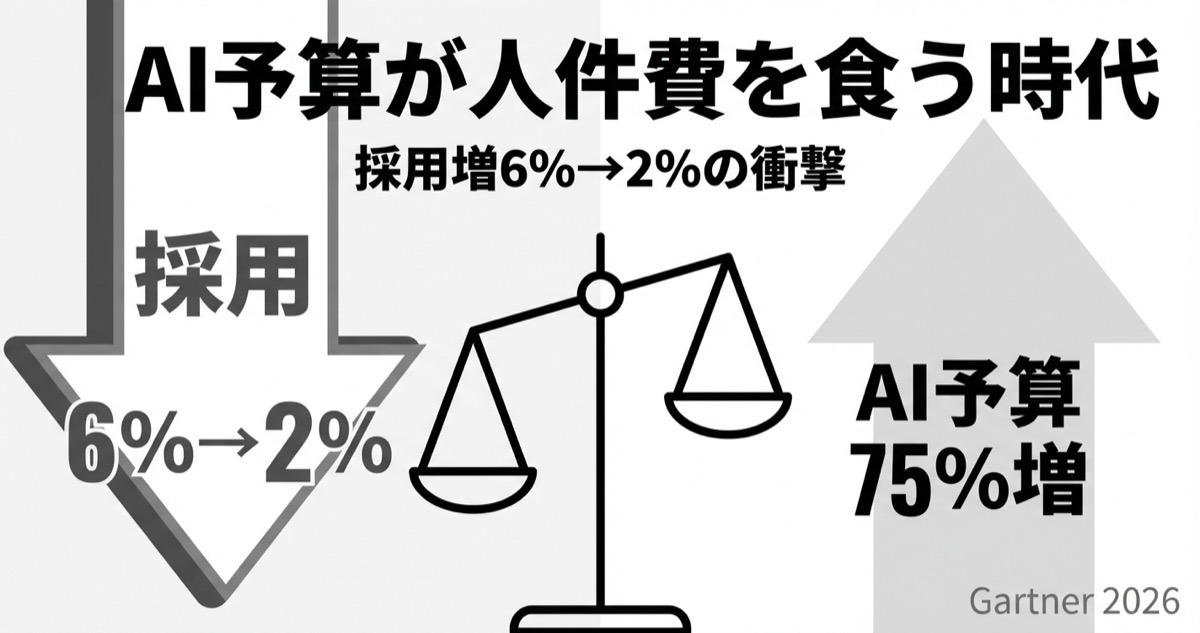

- Gartner予測: 2025年の世界AI支出は約1.5兆ドル。2026年は約2.5兆ドル(約375兆円)に急増見込み。AIインフラソフトウェアだけで2,300億ドル、前年の600億ドルから約4倍増(CIO Dive / Gartner)

- NVIDIA CEO: 「2030年までにAIインフラに3〜4兆ドルが投じられる」

なぜこれほど巨額の投資が集まるのか。答えは単純です。AIの推論需要が爆発的に増えているから。ChatGPTの週間アクティブユーザーは数億人規模。企業のAIエージェント導入も加速している。この需要を支えるインフラが、圧倒的に足りていないのです。

なぜ重要か──日本企業の「AI高すぎ」問題に終わりが見える

ここからが、日本の経営者にとって最も重要な話です。

日本企業のAI導入が遅れている最大の理由の一つは、「コストが見合わない」という判断です。

社内文書をAIに読み込ませて検索できるようにしたい。でもAPI利用料が月に数十万円かかる。社員10人の中小企業には重すぎる。こういう話は日本中で起きています。

しかし、Vera Rubinが市場に出回る2026年後半以降、この状況が構造的に変わります。

推論コスト10分の1が意味すること

今まで月30万円かかっていたAI利用料が、3万円になる。

もちろんクラウド事業者の価格設定次第ですが、ハードウェアの性能が10倍になれば、サービス価格も大幅に下がるのは時間の問題です。すでにAWS、Google Cloud、Microsoft Azure、Oracle CloudがVera Rubinベースのインスタンスを提供予定です。

これは、以下のようなAI活用が「中小企業でも現実的」になることを意味します。

- 社内ナレッジベース: 過去の見積書、契約書、議事録をまとめてAIに読み込ませ、自然言語で検索

- AIカスタマーサポート: 24時間対応の問い合わせ対応を、人件費の10分の1で運用

- AIエージェント: 経費精算、在庫管理、レポート作成を自律的に実行するAI従業員

- 多言語対応: インバウンド向けの自動翻訳・接客支援

どう活かすか──明日からできる3つのアクション

1. 来週のGTC 2026基調講演を観る(無料)

3月16日(月)午前11時(太平洋時間)= 日本時間3月17日(火)午前4時。ジェンスン・フアンの基調講演はライブ配信され、アーカイブも無料で視聴可能です。AIの今後2年の方向性がわかる、年に一度のスピーチです。

2. 「推論コスト10分の1」で自社のAI導入計画を見直す

「AIは高いから後回し」と判断していた案件を、もう一度コスト試算してみてください。2026年後半にクラウド各社がVera Rubinベースのサービスを提供開始すれば、コスト前提が根本から変わります。今のうちに「何をAIにやらせたいか」のリストを作っておくべきです。

3. 「訓練」ではなく「推論」を前提にAI戦略を組み直す

2024〜2025年のAI議論は「自社で独自AIを作るべきか」が中心でした。しかし2026年は違います。既製のAIモデル(GPT-5.4やClaude Opus 4.6)を、自社データと組み合わせて「使う」ほうが圧倒的にコスト効率が良い。そして「使う」コストが10分の1になる。この前提で戦略を組み直す時期です。

元ソース

- NVIDIA CEO Jensen Huang and Global Technology Leaders to Showcase Age of AI at GTC 2026(NVIDIA Newsroom)

- Inside the NVIDIA Rubin Platform: Six New Chips, One AI Supercomputer(NVIDIA Technical Blog)

- NVIDIA Rubin CPX Accelerates Inference Performance(NVIDIA Technical Blog)

- Sandberg, Clegg join Nscale board as ‘Stargate Norway’ startup hits $14.6B valuation(TechCrunch)

- Nscale Raises $2 Billion in Series C(Nscale)

- Global AI spending to approach $1.5 trillion this year(CIO Dive / Gartner)

- OpenAI raises $110B in one of the largest private funding rounds in history(TechCrunch)

- Nvidia GTC 2026 Preview: Two Major Architectures Launch Together(TradingKey)

- Nvidia taps Korean duo for flagship Vera Rubin AI memory(TechBriefly)